Google araştırmacıları 2017 yılında «Attention Is All You Need» başlıklı bir makale yayınladı. Bu makale bugüne dek 173 binin üzerinde atıf alarak son on yılın en etkili makine öğrenimi çalışması haline geldi. Sekiz yıl önce sadece bir deney olarak başlayan bu yapı, artık GPT-4, Claude, Gemini ve Llama gibi milyarlarca parametreye sahip büyük dil modellerinin temelini oluşturuyor. Peki bu dikkat mekanizması tam olarak ne yapıyor ve neden bu kadar kritik önem taşıyor?

Dikkat Mekanizmasının Temelleri ve Transformer Öncesi Dönem

Doğal dil işleme dünyası, Transformer mimarisinden önce tekrarlayan sinir ağlarına dayanıyordu. Bu ağlar cümleleri kelime kelime, soldan sağa doğru işliyordu. Uzun cümlelerde baştaki kelimeleri unutma sorunu sıkça karşılaşılan bir durumdu. Araştırmacılar bu sorunu çözmek için çeşitli geçici çözümler üretti, ancak hiçbiri kalıcı bir başarı sağlamadı.

Dikkat mekanizması bu noktada farklı bir yaklaşım sundu. Sistem, bir cümledeki her kelimeyi diğer tüm kelimelerle ilişkilendirerek bağlamı kavramaya başladı. İnsan beyninin de benzer bir şekilde çalıştığı düşünülüyor. Bir cümle okurken kelime anlamını yalnızca kendisinden değil, çevresindeki diğer kelimelerden alıyoruz. Bu yaklaşım sinir ağlarına adeta bir çalışma belleği kazandırdı; kusursuz veya sınırsız değil, ancak binlerce kelimeyi aynı anda bağlam içinde değerlendirebilen bir bellek.

Transformer mimarisi, dikkat mekanizmasını merkeze alan ilk yapı oldu. Önceki yöntemlerde veri sıralı işlendiği için donanım paralelliğinden tam olarak yararlanılamıyordu. Transformer ise tüm kelimeleri aynı anda değerlendirdi. Bu özellik, eğitim süresini dramatik biçimde kısalttı ve modellerin çok daha büyük boyutlara ulaşmasını mümkün kıldı.

Self-Attention Nasıl Çalışıyor: Sorgu, Anahtar ve Değer Üçgeni

Self-attention, dikkat mekanizmasının en temel hali. Bu yapıda sistem her kelime için üç farklı vektör üretiyor: sorgu, anahtar ve değer. Bu üçlüyü bir kütüphane aramasına benzetmek mümkün. Sorgu, aradığınız kitabın özelliklerini tanımlıyor. Anahtar, raftaki her kitabın etiketini temsil ediyor. Değer ise kitabın içindeki gerçek bilgiye karşılık geliyor.

Sistem bir kelimeyi işlemeye başladığında, o kelimenin sorgu vektörünü cümledeki diğer tüm kelimelerin anahtar vektörleriyle çarpıyor. Bu çarpma işlemi, kelimeler arasındaki ilişki gücünü sayısal olarak ortaya koyuyor. Örneğin «banka» kelimesi «para» kelimesiyle yüksek bir puan üretirken, «masa» kelimesiyle düşük bir puan üretecektir. Bu puanlar daha sonra normalize edilerek olasılık dağılımına dönüştürülüyor.

Normalize edilen bu ağırlıklar, değer vektörleriyle çarpılıp toplanıyor. Sonuçta her kelime, cümledeki diğer kelimelerin katkısıyla zenginleştirilmiş yeni bir temsil elde ediyor. İşlem sonunda «banka» kelimesi sadece kendisi değil, «para», «kredi», «faiz» gibi bağlam kelimelerinin bilgisiyle donatılmış oluyor. Burada önemli bir nokta var: hangi ilişkilerin önemli olduğu sabit olarak tanımlanmıyor, model eğitim sürecince bunu kendisi öğreniyor.

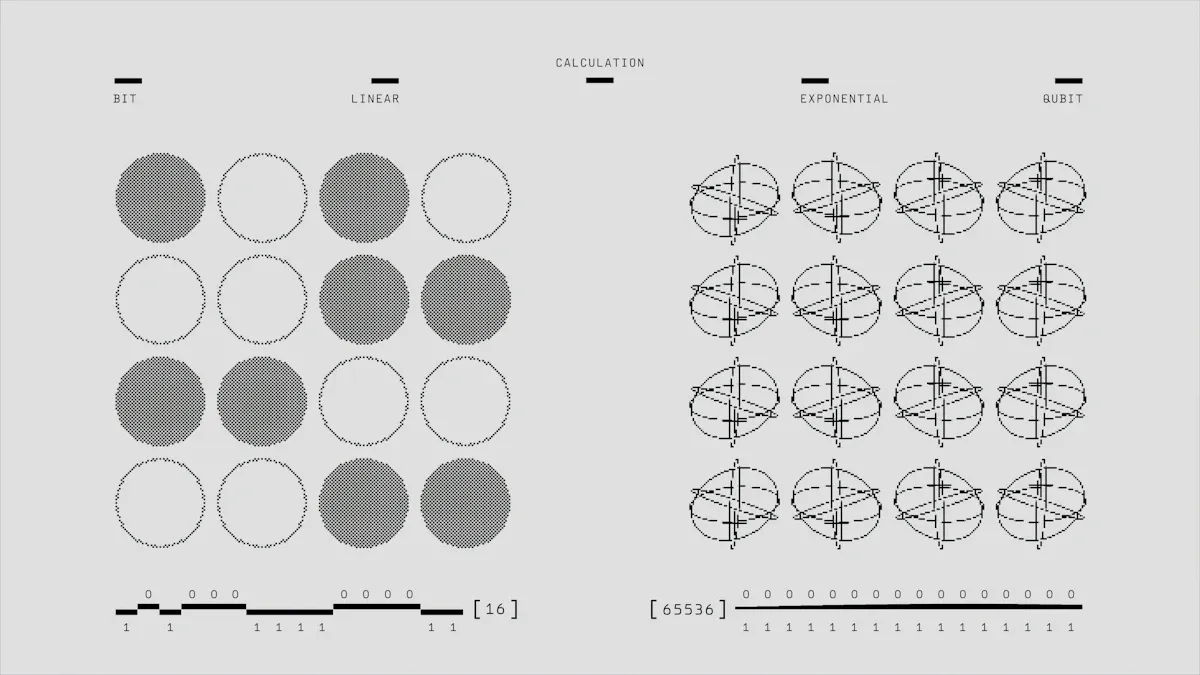

Çok Başlı Dikkat ve Hesaplama Kapasitesi

Pratikte tek bir dikkat katmanı yerine çok başlı dikkat kullanılıyor. Bu yöntemde sistem aynı anda birden fazla sorgu, anahtar ve değer seti üretiyor. Her baş farklı bir ilişki türüne odaklanıyor. Bir baş gramer yapısını incelerken, diğeri anlamsal ilişkileri yakalayabiliyor. GPT-2 ve OLMo gibi modeller bu standart çok başlı dikkat yapısını benimsiyor.

Çok başlı dikkat sayesinde model aynı anda birden fazla açıdan kelime ilişkilerini değerlendirebiliyor. Baş sayısı genellikle sekiz ile doksan altı arasında değişiyor. Daha fazla baş kullanmak hesaplama maliyetini artırsa da, modelin bağlamı kavrama yeteneğini önemli ölçüde geliştiriyor.

Flash Attention 4: Bellek ve Hız Devrimi

Self-attentionın en büyük sorunu hesaplama karmaşıklığı. Bir cümledeki kelime sayısı n olduğunda, dikkat matrisinin boyutu n çarpı n oluyor. Yüz kelimelik bir metin için on bin elemanlık bir matris hesaplanıyor. Bin kelimelik bir metinde bu rakam bir milyona ulaşıyor. Bağlam penceresini iki katına çıkardığınızda hesaplama maliyeti dört katına yükseliyor. Bu durum, özellikle uzun metinlerde ciddi bellek sorunlarına yol açıyor ve milyarlarca dolarlık mühendislik çabasını tetikliyor.

Flash Attention serisi, bu sorunu çözmek için geliştirildi. Standart dikkat mekanizması tüm dikkat matrisini bellekte tutarken, Flash Attention matrisi parçalara bölerek işliyor. Bu yaklaşım, bellek kullanımını doğrusal düzeye çekiyor. İlk Flash Attention sürümü bellek tasarrufu sağlarken, hız konusunda sınırlı iyileşme sunuyordu.

Flash Attention 4, bu serinin en gelişmiş hali. Donanım seviyesinde optimize edilmiş bu sürüm, hem bellek hem hız konusunda kayda değer ilerlemeler sunuyor. Mart 2026 itibarıyla NVIDIA Blackwell GPU'lar üzerinde saniyede 1605 TFLOPs performansına ulaşabiliyor. Özellikle grafik işlemci birimlerinin bellek hiyerarşisi daha verimli kullanılıyor. Ara bellek taşıma işlemleri minimize edilerek hesaplama yoğunluğu artırılıyor.

Seyrek Dikkat ve Hibrit Mimariler

Tüm kelimeleri birbiriyle ilişkilendirmek her zaman gerekmiyor. Uzun metinlerde çoğu kelime çifti arasında anlamsal bir bağ bulunmuyor. Seyrek dikkat mekanizmaları bu gerçeği temel alıyor. Sistem sadece anlamsal olarak ilgili kelime çiftlerini hesaplıyor, geri kalanları atlıyor.

Bazı modern mimariler, seyrek dikkati yoğun dikkatle birleştiriyor. Hibrit yaklaşımda yakın kelimeler arası ilişkiler yoğun dikkatle, uzak kelimeler arası ilişkiler ise seyrek dikkatle hesaplanıyor. Bu strateji, hesaplama maliyetini düşürürken bağlam kavrama performansını korumayı hedefliyor. Gruplandırılmış sorgu dikkat ve çoklu anahtar dikkat gibi varyantlar da bu amaca hizmet ediyor; anahtar ve değer vektörlerini başlar arasında paylaşıp bellek kullanımını azaltırken performansı koruyor.

Apple mühendislerinin cihaz üzerinde çalışan modeller için geliştirdiği optimizasyonlar da bu çerçevede değerlendirilebilir. Llama 3.1 modelini Core ML çerçevesiyle M1 Max çip üzerinde çalıştıran ekip, kaynak kısıtlı ortamlarda dikkat mekanizmasını sadeleştirerek saniyede yaklaşık 33 token üretim hızına ulaştı. Bu çalışmalar, akıllı telefonlarda bile büyük dil modellerinin çalışmasını mümkün kılıyor.

Graf Yapılı Verilerde Dikkat Mekanizması

Dikkat mekanizması artık sadece metinle sınırlı değil. Graf yapılı verilerin işlenmesinde de dikkat temelli yaklaşımlar kullanılıyor. Sosyal ağlar, moleküler yapılar ve bilgi grafları düğüm ve kenarlardan oluşan yapılar. Bu verilerde düğümler arası ilişkileri yakalamak için dikkat mekanizması uygun bir araç olarak öne çıkıyor.

Ancak standart dikkat mekanizmasını graf verilerine doğrudan uygulamak bazı zorluklar barındırıyor. ICML 2025'te sunulan bir araştırma, büyük dil modellerinin graf yapılarındaki düğüm ilişkilerini tam olarak modelleyemediğini gösteriyor. Graf yapısı sabit bir sıra içermiyor, dolayısıyla pozisyon kodlaması farklı biçimde ele alınıyor. Tam bağlı dikkat penceresi ile graf sinir ağlarının kullandığı sabit bağlantı penceresinin hiçbiri tek başına yeterli değil. Araştırmacılar, eğitim aşamasında ara durumda bir dikkat penceresi kullanıp çıkarım sırasında tam bağlı pencereye geçiş yapmanın performansı artırdığını keşfetti.

Gelecek Perspektifi ve Mimari Gelişmeler

Dikkat mekanizması sürekli evrim geçiriyor. Bazı yeni mimariler dikkat mekanizmasını tamamen kaldırmayı deniyor. Bununla birlikte, şu anki kanıtlar dikkatin büyük dil modelleri için hâlâ vazgeçilmez bir bileşen olduğunu gösteriyor. Önemli olan nokta, dikkati daha verimli kullanmak.

MIT Press tarafından yayımlanan bir analiz, büyük dil modellerinin pratik uygulamalardaki sınırlarına dikkat çekiyor. Finansal danışmanlık gibi kritik alanlarda modellerin güvenilirliği, temel aldıkları mimari kararlarla doğrudan ilişkili. Modelin alan uzmanlığını kullanıcının durumuna uyarlayabilme yeteneği, güvenilirlik ve etik standartlara uygunluk gibi konular, dikkat mekanizmasının ötesinde mimari düzeyde çözülmesi gereken sorunlar.

Öte yandan çok dilli değerlendirme çalışmaları, dikkat mekanizmasının farklı dillerdeki dilbilgisel özellikleri yakalama konusundaki kapasitesini ölçmeye devam ediyor. MultiBLiMP 1.0 çalışması 101 dilde 128 binden fazla minimal çift üzerinden modelleri test ederek, özellikle düşük kaynaklı dillerdeki zayıflıkları ortaya koyuyor. Floating-point hesaplamalarındaki yuvarlama hataları da dikkat ağırlıklarının kalitesini etkileyen bir başka faktör olarak öne çıkıyor. IEEE 754 standardının getirdiği özel değerler ve sezgisel olmayan davranışlar, dikkat hesaplamalarının doğruluğunu dolaylı yoldan etkileyebiliyor.

Dikkat mekanizması, yapay zekanın dil anlama yeteneğinin kalbidir. Self-attention bağlamı kavramayı, Flash Attention 4 ise bunu verimli biçimde yapmayı mümkün kılar. Gelecekte bu mimari nasıl evrileceğini tahmin etmek zor, ancak dikkatin bir şekilde kalacağı açık. Sizce dikkat mekanizması yerine tamamen farklı bir yapı kurgulanabilir mi, yoksa bu yaklaşımın ötesine geçmek için ne gibi yeniliklere ihtiyaç duyulur?

yorumlar